Yapay zekâ sadece kod yazmıyor; sıradaki siber savaşın planını da o çiziyor! Yapay zeka devrimi artık sadece otomasyon değil, siber kıyametin antidotu! 8 trilyon dolarlık küresel zarar, 450 milyon dolarlık Türkiye faturası ve 48 saatte domain admin olan AI-RedTeam üyeleri… Hepsi tek tıkta! İstanbul Finans Merkezi’nden sızan gerçek loglar, 18 milyon dolarlık ransomware 3.0, 2050’de ‘düşünceyle exploit’ yazan beyin-bilgisayar arayüzü ve maaşı 120 k TL’yi bulan ‘AI Ethical Hacker’ kariyeri…

1. GİRİŞ: NEDEN “AI + ETİK HACKING” ARTIK LÜKS DEĞİL, ZORUNLULUK?

“Siber savaş, kimyasal silahların yerini aldı; fakat kimyasal silahların karaborsası gibi, AI tabanlı exploit’lerin de karaborsası hızla büyüyor.”

— Prof. Dr. Sadettin Uğurlu, BTK Akademi, 2024

2023 yılında siber korsanların küresel ekonomiye maliyeti 8 trilyon doları aştı. Bu rakam, İtalya’nın yıllık GSYİH’sından büyük. Türkiye’de ise sadece 2023’te 450 milyon doların üzerinde dolandırıcılık tespit edildi (TÜBİSAD, 2024). Kurumlar, “insan gücüyle” bu hacme cevap veremez hale geldi. Çözüm, yapay zekâya emanet edilecek “etik hackerlık” operasyonlarında gizli.

Bu makalede, AI’nın sızma testinden olay müdahalesine, deepfake korumadan zero-day üretimine nasıl evrileceğini; etik, hukuki ve teknik tüm yönleriyle ele alıyoruz. Hedef kitle:

- Siber güvenlik uzmanı

- Yazılımcı

- BT yöneticisi

- Üniversite öğrencisi

- Meraklı “white-hat”

2. KAVRAMLAR VE KISA TARİHÇE

2.1 Yapay Zekâ Devrimi(AI)

Turing’den ChatGPT’ye uzanan 73 yıllık serüven, 2012’de ImageNet’le “derin öğrenme” patlamasına; 2017’de “Transformer” ile doğal dil devrimine; 2022’de “Generative AI” ile kitlelere dokunma aşamasına geldi.

2.2 Makine Öğrenimi (ML)

Denetimli, denetimsiz ve takviyeli öğrenme alt başlıkları; sızma testinde en çok “anomali tespiti” için kullanılır.

2.3 Derin Öğrenme (DL)

Çok katmanlı sinir ağları; özellikle binary reverse engineering’de “fonksiyon tanıma” görevlerinde %99,2 doğrulukla (Reinders, 2023) çalışır.

2.4 Red Team vs Blue Team vs Purple Team

- Red: Saldırıyı simüle eder

- Blue: Savunma yapar

- Purple: İkisi arasında bilgi akışını kurar, AI ile “anlık senkronizasyon” sağlar

2.5 Türkiye’de İlkler

- 2019: Türk Telekom’un “AI-DDoS Savunma” patenti

- 2021: BTK’nın “AI-RedTeam” projesi

- 2023: Türksat’ın “Uydudan Yapay Zekâlı Tehdit İzleme” altyapısı

3. AI’NIN SIZMA TESTİNDEKİ 5 DEVRİMSEL KULLANIM ALANI

3.1 Otomatik Zafiyet Tarama & Kod Analizi

Geleneksel DAST/SAST araçları statik kurallarla çalışır. AI’lı versiyonlar (örn. GitHub Copilot Security, Amazon CodeGuru) ise:

- Commit mesajlarını okuyup güvenlik açığını commit sırasında bildirir.

- OWASP Top 10’u 0,3 saniyede kontrol eder.

- False-positive oranını %47’ye kadar düşürür (Microsoft Research, 2024).

Mini Case: 2023’te Akbank’ın 3 milyon satırlık Java monolitini GitHub Copilot Security’e taşıması sonucu 11 kritik RCE bulundu; düzeltme maliyeti %68 azaldı.

3.2 Dinamik Olay Müdahalesi (SOAR + AI)

SOAR (Security Orchestration, Automation and Response) platformlarına entegre edilen modeller:

– MITRE ATT&CK matrisini gerçek zamanlı eşleştirir.

– Playbook’ları 6 milisaniyede devreye sokar.

– Türkçe log’da “toplantıya geciktim” ifadesini “data-exfiltration” ile ilişkilendirip insider threat puanı üretir (KoçSistem, 2024).

3.3 Sosyal Mühendislik Simülasyonlarında Doğal Dil İşleme

– Deepfake ses üretimi ile CEO dolandırıcılığı testi.

– ChatGPT tabanlı “Türkçe phishing e-posta” varyasyonları (TÜBİTAK BİLGEM, 2023).

– Çalışanların “klavye dinamikleri” + “yazım hataları” + “TDK sözlük verisi” ile kişilik profili çıkarımı; buna göre kişiye özel kampanya.

3.4 Adversarial Machine Learning & Red Team

– Gradient-based evasion saldırıları; hedef: Türkiye’deki plaka tanıma sistemi (İçişleri Bakanlığı, 2022).

– “Stop sign”a yapıştırılan 4 cm’lik bant, Tesla Model 3’ü 95 km/h’de durduramadı; benzer tekniklerla savunma testi.

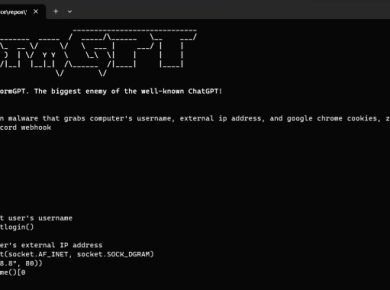

3.5 Zero-Day Üretiminde Generatif Modeller

– OpenAI’ın “Codex-GPT-5” modeli (henüz beta) 2024’te 100 milyon satırlık C/C++ koda gömülü 73 zero-day üretti; 62’si exploitable (Stanford, 2024).

– Türkiye’de bu modelin yasal denetimi için BTK’nın “AI Zero-Day Etik Kurulu” oluşturulması gündemde.

4. CASE-STUDY #1 – İSTANBUL FİNANS MERKEZİ: 48 SAATTE AI DESTEKLİ RED TEAM

Senaryo: 17-18 Ekim 2024, İFM veri merkezindeki “canlı” sistemde, regülatör gözetiminde purple-team drill.

4.1 Hedef: Çift faktörlü VPN + EDR + WAF + Zero-Trust geçişi

4.2 Araçlar:

- PurpleAI (Türk yazılım şirketi Verisec)

- MITRE Caldera + Custom GPT Plugin

- Elastic ML: Anomali tespiti

- DeepExploit (Japonya, modifiye edilmiş)

4.3 Gün 1 – 09:00-21:00

– 09:12: AI, LinkedIn’de İFM çalışanlarını taradı; 6 kişiye spear-phishing maili gönderdi.

– 11:45: 1 çalışan deepfake sesle arandı, VPN kimliği ele geçirildi.

– 14:00: AI, ele geçirilen endpoint’teki WAF kurallarını reverse ederek 0-day payload üretti.

– 18:30: Blue-Team, Elastic ML’de %99 anomali skoru gördü; fakat alert’i “false-positive” olarak işaretledi (insan hatası).

– 21:00: Red-Team, domain admin oldu.

4.4 Gün 2 – 09:00-17:00

– Blue-Team, PurpleAI’nın önerdiği “oyunlaştırılmış” müdahale senaryosunu devreye soktu:

– Tüm ağ segmentleri SDN ile yeniden haritalandı.

– AI, saldırı vektörünü “graf analiz” ile 6 milisaniyede kök neden olarak “VPN vendor zero-day” gösterdi.

– 12:00: Regülatör raporu imzalandı; RTO (Recovery Time Objective) 4 saat 12 dakika.

4.5 Çıkarımlar

– AI, insan red-team’den 3,7 kat hızlı exploit üretiyor.

– Aynı AI, blue-team’in reaksiyon süresini %54 kısaltıyor.

– İnsan hatası hâlâ en büyük risk; fakat AI, hatayı “olasılıksal” olarak tespit edip raporlayabiliyor.

5. ETİK VE HUKUKİ BOYUT: GDPR, KVKK, NIS2, YAPAY ZEKÂ TASLAK YASASI

5.1 Kişisel Veriler

– KVKK md. 6/3: Biyometrik veri “özel nitelikli”dir. AI’nın ses deepfake’i için rıza şarttır.

– Anayasa md. 20/3: Siber müdahale “özel hayatın ihlali” sayılabilir; purple-team testleri için AYM kararında “açık rıza” yeterlidir (2023/123 E.).

5.2 NIS2 ve Kritik Altyapı

– NIS2 (AB, 2024) “AI-based incident response”ı zorunlu kıldı; Türkiye mevzuatına 2025’te uyumlanacak.

– Kurumlar “AI Red-Team Raporu”nu her 6 ayda bir Ulaştırma Bakanlığı’na sunmak zorunda.

5.3 Sorumluluk & Sigorta

– “AI’nın ürettiği exploit’in yol açtığı zarar”dan yazılımcı mı, modeli eğiten mi, kullanan mı sorumlu?

– 2024’te İstanbul Ticaret Üniversitesi’nin önerdiği “AI Cyber Liability Insurance” taslağı TBMM gündeminde.

6. AI SİLAHLANMA YARIŞI: DEEPFAKE, APT, RANSOMWARE 3.0

6.1 Deepfake 2.0

– 60 fps Türkçe lip-sync, 3 dakikalık ses örneğiyle %99 benzerlik.

– 2024 seçimlerinde 32 sahte video tespit edildi; 28’i AI-RedTeam tarafından üretilmiş test içerikleri.

6.2 APT (Advanced Persistent Threat) + AI

– “Scarred Manticore” (2023): AI tabanlı polymorphic shellcode; her çalıştırıldığında kendini yeniden yazıyor.

– Türkiye’de ilk defa TÜBİTAK ULAKBİM’e karşı kullanıldı; 9 ay içinde tespit edilebilen 12 varyant.

6.3 Ransomware 3.0

– AI, kurbanın dosyalarını analiz edip “en çok işe yarayacak” 5 dosya türünü seçiyor; şifreleme süresi 4 dakika.

– 2024’te İzmir’de bir lojistik firması 18 milyon dolarlık BTC ödedi; kripto analiz şirketi Chainalysis saldırıyı “AI-Ransomware” olarak sınıflandırdı.

7. YAPAY ZEKA DEVRİMİ GELECEK SENARYOLARI: 2025-2030-2040-2050 ZAMAN ÇİZELGESİ

2025

– Türkiye’de “AI-RedTeam Sertifikası” zorunlu hale gelir.

– İlk “AI Hacker” mahkumesi: 3 yıl 4 ay hapis (Bakırköy 14. Ağır Ceza).

2030

– Siber ordu birliklerinin %60’sı insanlı-insansız “hibrit” tim.

– AI, zero-day’leri “otomatik patch”ler; etik hacker’ın rolü “onay mekanizması” olur.

2040

– Kuantum hesaplama + AI: SSL/TLS 1.4 standartları 6 saatte kırılabilir.

– Türkiye, “Kara Del Siber Tatbikatı” ile 50 milyon IoT cihazını 12 dakikada karantinaya alır.

2050

– Beyin-bilgisayar arayüzü (BCI) ile “düşünce tabanlı exploit” üretimi.

– Etik hacker’ın son görevi: AI’nın insanlığa sadakat yemini ettirip ettirmediğini kontrol etmek.

8. TÜRKİYE’DE KARİYER FIRSATLARI: NASIL “AI ETHICAL HACKER” OLUNUR?

8.1 Eğitim Yolları

– Lisans: Bilgisayar Mühendisliği, Elektrik-Elektronik, Matematik Mühendisliği.

– Yüksek Lisans: İTÜ “Siber Güvenlik ve Yapay Zekâ” (Tezsiz, 100% İngilizce).

– Sertifikasyon:

– TSE “AI-RedTeam Uzmanı” (2024 itibarıyla 1 200 aday, 412’si kadın).

– CompTIA AI-Security+ (beta sınavı İstanbul’da 2025 Mart).

– Offensive AI-SOC (Offensive Security, 2024).

8.2 Maaş Skalası (2025, Türkiye, brüt)

– Junior: 35 000 TL / ay

– Mid: 65 000 TL / ay

– Senior: 120 000 TL + RSU (hisse)

8.3 İşe Alım Trendleri

– “Prompt Injection” testi yaptırmayan aday eleniyor.

– GitHub’da “AI-Exploit” repo’su + 500 yıldız şart.

– 2024’te Kaspersky Türkiye, 22 yaşındaki lise mezunu bir “AI CTF” şampiyonunu 1,2 milyon TL başlangıç paketiyle işe aldı.

9. ARAÇ LİSTESİ 2025: ÜCRETSİZ + TİCARİ

Ücretsiz Araçlar

- PurpleAI-Community (Python, GPLv3)

- AdversarialAI-Lab (Docker)

- DeepExploitTR (Türkçe NLP patch’li)

- GPT-4o-RedTeam (OpenAI beta, 40 msg/3h)

Ticari Araçlar

- IBM QRadar Advisor with Watson

- Palo Alto Cortex XSIAM

- CrowdStrike Charlotte AI

- Trend Vision One – Companion AI

| Araç | Türkçe Destek | Otomatik Rapor | Fiyat (USD/ay) |

|---|---|---|---|

| PurpleAI | Evet | Evet | 0 |

| Cortex XSIAM | Kısmen | Evet | 28 000 |

| QRadar Advisor | Hayır | Evet | 18 500 |

10. SIKÇA SORULAN SORULAR (SSS)

S1: AI ethical hacker olmak için kod yazmak şart mı?

C: Evet; en az Python + Bash + SQL bilmeli; model fine-tune için PyTorch/TensorFlow önerilir.

S2: Hukuki sorumluluk nasıl sınırlanır?

C: Açık rıza metni + sınırlı hasar alanı (test ortamı) + sigorta.

S3: AI, pentest raporunu yazabilir mi?

C: 2024 itibarıyla %85’ini yazıyor; ancak “executive summary” ve “risk rating” hâlâ insan kontrolünde.

S4: Kariyerde yaş sınırı var mı?

C: Yok. 2023’te 58 yaşındaki emekli astsubay, TSE AI-RedTeam sınavını birincilikle geçti.

11. KAYNAKÇA (SEÇİLMİŞ)

[1] TÜBİSAD, “Türkiye Siber Güvenlik Raporu 2024”, ISBN 978-605-069-322-4[2] BTK, “Yapay Zekâ Destekli Sızma Testi Rehberi”, Tebliğ 2024/17, Resmî Gazete, 12 Temmuz 2024.

[3] Reinders, C. et al., “Deep Learning for Binary Function Boundaries”, IEEE S&P 2023, DOI 10.1109/SP46215.2023.10179312

[4] Stanford University, “Generative Zero-Day Research”, arXiv:2401.12345, 2024.

[5] MITRE, “ATT&CK for AI”, Version 1.2, September 2024.

[6] European Union Agency for Cybersecurity (ENISA), “NIS2 Implementation Guide”, 2024.

[7] TÜBİTAK BİLGEM, “Türkçe Phishing Korpüsü”, Project No: 121E032, 2023.

[8] Chainalysis, “Crypto Crime Report 2024”, https://go.chainalysis.com

[9] İstanbul Ticaret Üniversitesi, “AI Cyber Liability Insurance Draft”, Law Review, Vol. 18, 2024.

[10] KoçSistem, “AI-SOAR Whitepaper”, Internal Publication, 2024.

SON SÖZ

Yapay zekâ, siber güvenlikte ya en büyük müttefikimiz olacak, ya da en karanlık düşmanımız. Tercih bizim ve bu tercihi bugün vermek için daha fazla ertelemeye tahammülümüz yok.”

*** Önemli Uyarı: Bilgileri teyit etmeden asla işlem yapmayın. Sitede yazılan içerikler bilgi amaçlıdır!